2016年05月13日

最近では、フォトグラファーがムービー撮影の技術を求められることも少なくない。この講演では千葉孝氏が講師を務め、CMなどの撮影監督、DIT(デジタルイメージテクニシャン)の立場から、基本的な撮影テクニックや周辺機材、また映像の色やトーンを加工して完成度を高めるカラーコレクションの基礎知識について解説した。

千葉 孝氏

千葉 孝氏

今日は本セミナーにお越しいただきありがとうございます。今日は写真のイベントということなので、本日いらっしゃった方も、写真関係のお仕事をされている方が多いのではないかと思います。最近はフォトグラファーの方から「ムービーを撮りたいけれどどうしたらいい?」といった相談をされることが増えてきました。スチール撮影の仕事の中で、ちょっとした動画を撮るよう依頼されるケースが増えているようです。

質問の多くは、撮影時の設定をどうすればいいのかといった点です。そこで今日はまず、フォトグラファーの方がつまづきやすい動画設定のポイントについて、さらに動画の編集、特にカラーグレーディングについて話をしてみたいと思います。どうぞよろしくお願いいたします。

私は、普段はムービーカメラマンとして仕事をしています。ムービーのカメラマンというのは、普通、機材は仕事ごとにレンタルして使用することが多いんです。ですので、プロジェクトによってさまざまなメーカーのカメラを使います。もちろん一眼レフタイプのカメラ(DSLR)も使っています。

肩書きにある「DIT」、デジタルイメージテクニシャンとは、この数年で使われるようになった用語です。撮影データをトータルに扱うスタッフと位置づけられる仕事です。昔からの映像業界で言うと「ビデオエンジニア」の仕事がそれに近いかもしれませんが、その役割はもう少し広く、どういうカメラを使い、どういうコーディングで撮影をすると一番いいのかといったことを、合成やアウトプットまでを念頭に置きつつ、トータルにサポートする仕事です。ちなみに「カラリスト」という仕事もムービーの世界で職種として確立しています。そちらは作品の色全般、クリエイターとして色に関して責任を持つという仕事のことです。

最近は映像の仕事と関連して、文章も書かせていただくなどしており、玄光社の『コマーシャル・フォト』『ビデオサロン』誌上で、カメラのレビューなどを書かせていただいております。コマーシャル・フォトでは、ニコンD810の動画機能の連載を書かせてもらってますので、よろしければご覧いただけたらと思います。

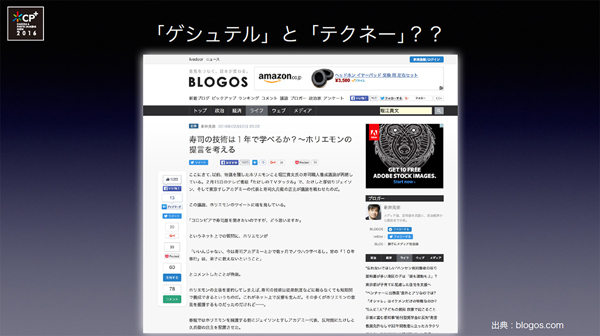

ゲシュテルとテクネー

いきなり本題から逸れるようで恐縮なのですが、先日、堀江貴文さんが「寿司屋に修行は必要ない」といった趣旨の発言をされて話題になったのをご存じでしょうか。技術よりもセンスの方が大事だといった論旨だったかと思います。この発言には賛否両論がありまして、「やはり必要だ」という意見もあれば、「魚を触るまで3年」といった寿司屋の修行の仕方に意味はない、といった意見もあったようです。

この議論については、新井克也さんがブログに書かれていた記事がとても面白かったのでご紹介します。新井さんは哲学者のハイデガーが提唱した「ゲシュテル」と「テクネー」という言葉を使って、この問題の見方を説明していらっしゃいました。「ゲシュテル」というのはマニュアルを読めば確立する技術のこと、「テクネー」は、人間が何かを突き詰めていく過程の中で長い時間かけて身に付ける技術のことを言います。新井さん曰く、寿司屋の議論は「ゲシュテル」と「テクネー」の2つの側面が混同しているから、かみ合わないというんです。確かに、そう考えると議論はスッキリするように思えてきます。

新井克弥氏 「寿司の技術は1年で学べるか?〜ホリエモンの提言を考える」

新井克弥氏 「寿司の技術は1年で学べるか?〜ホリエモンの提言を考える」

http://blogos.com/article/162331/

それに例えるなら、「CP+」はいわばゲシュテルの祭典です。新しい技術がどんどんと我々の手に届くところに来ていることが確認できる。これはすばらしいことです。たとえばタッチセンサー。ボタンを押せば写るカメラ。きれいな画像が撮れるスマホ。これらは今や誰でも手に入る技術です。ただし、その一方で現場での日々の積み重ねでしか得ることのできない「テクネー」的なものがある、ということはおわかりいただけるかと思います。これから、僕が話すことはゲシュテル的なことです。あくまでも入り口にすぎません。「テクネー」を身につけるにはやはり、日々やり続けるしかない。今日はそんな「テクネーの入り口」まで行くことができたらいいなと思ってます。

ただし、これまでフォトグラファーとして仕事をしてきた方にとって、動画はやってみたいけれども、機材など仕事の入り口がわからないという方も多いのではないでしょうか。ちなみに海外の撮影監督は、カメラをのぞくことはまずありません。仮にのぞいたとしても、オペレーションを担当することはありません。彼らは撮影全般の総責任者の仕事をします。実はこの部分が日本と海外の動画撮影の大きな違いと言えます。大事なのは撮りたいイメージを持つこと、それを実際に撮ることであって、機材の調整や数値で悩まされるのは時間もエネルギーももったいない、という考え方です。ですので、撮影自体はプロのカメラオペレーターにアウトソーシングをしてという形ですね。みなさんが今後、動画の仕事をするならば、その方法も一つのあり方かな、と思います。

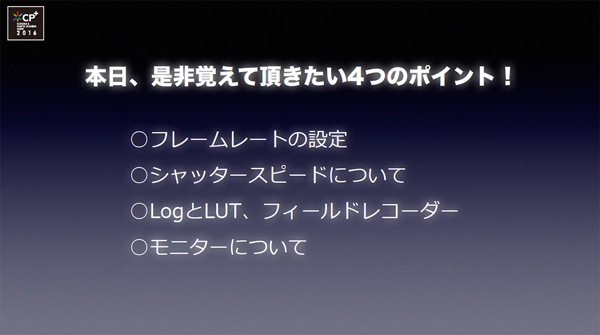

動画を始めるにあたって知っておきたい4つのポイント

さて、動画の世界での2016年のトレンドはというと「4K撮影に対応したDSLR」ということになるでしょうか。4K動画が撮影できるカメラがいよいよ出そろってきました。パナソニックの「LUMIX DMC-GH4」やソニーの「α7 R II」や「α7S II」、「ニコンD5」「D500」といった機種で4Kの内部収録ができるようになりました。さらに先日登場したキヤノンの「EOS-1D X Mark II」では、4K60Pの撮影・内部収録ができるようになりました。今後いよいよ、プロに求められるフォーマットも4Kになっていくと言えるかと思います。そんな中で、動画の初心者がつまづきやすい4つのポイントを紹介していこうと思います。

フレームレートの違いを知る

まず「フレームレート」ですが、動画を撮られている方は何となく身についている知識だと思いますが、後から変更しにくいこともあり、正しく理解しておく必要があります。

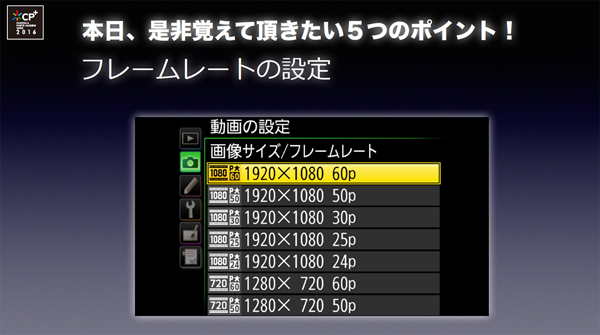

これはD810の画面なのですが、「1920×1080」のFHDサイズの60P、50P、30P、25P、24Pと並んでいて、その下には720ハーフと呼ばれる1280×720のサイズの設定が並んでいます。フレームレートは納品形態によってさまざまです。TV番組なのか、ネットのムービーなのか。さらにはDVDにするとか、コマーシャルで使うといったオプションが付いた、複雑な形態もあります。ここを間違えると大失敗になってしまいます。

Nikon D810の設定画面より。

Nikon D810の設定画面より。

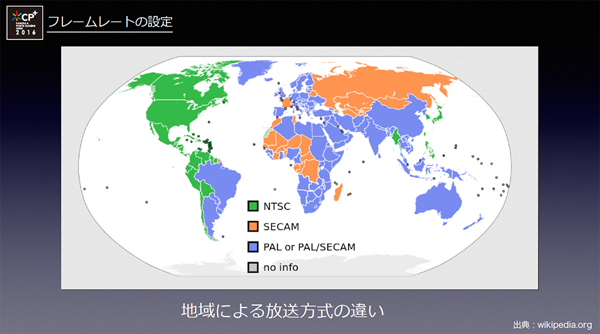

まず国・地域によって異なる放送方式の違いを押さえておきましょう。図を見てください。この緑の部分はNTSC、オレンジだったらSECAM、さらにはPALやPAL/SECAMといった割り振りがあります。それぞれNTSCでは1秒あたり約30フレーム、PALでは1秒あたり25フレームといった違いがあります。撮影した映像は日本国内だけでなく中国でも使う、といったケースもあるわけで、それぞれのルールを覚えておかなくてはなりません。

国・地域によって異なる放送方式が異なるためフレームレートも異なる。

国・地域によって異なる放送方式が異なるためフレームレートも異なる。

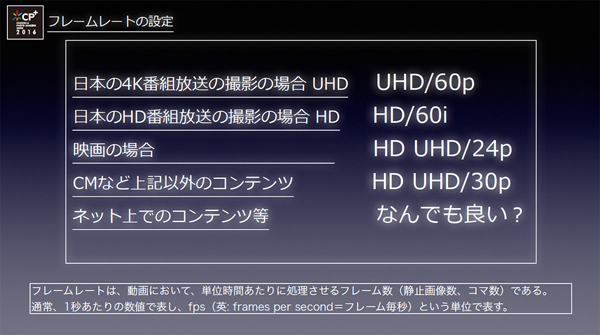

日本の4K番組はまだ試験放送の段階ですが、画面サイズがUHD、フレームレートは60Pと決まっています。今後放送は4Kになる方向に進んでいますが、そこで使われる規格がこれだというわけです。現状、このフレームレートで撮影できるDSLRは限られていますが、先ほど紹介したEOS-1D X Marl IIが対応しています。

国内でも使用媒体によってフレームレートはこのように異なる。

国内でも使用媒体によってフレームレートはこのように異なる。

現在の日本のハイビジョンはHD、60iです。iはインターレース方式を示し、30P60フィールドという仕組みです。ちょっと複雑ですが、30Pで撮った動画が自動的に変換される仕組みになってます。

映画の場合は24P、CMなどの場合は30Pということになります。ネット上のコンテンツに関しては、容量の制限はありますが、サーバが対応していればフレームレートはなんでもいいということになります。相手先の要望する納品形式で、ということになるでしょうか。

あとは例えばCMなどで、最終的には30Pに変換するものを、あえて24Pで撮るといったケースがあります。フレームレートが低いため、わずかにカクカクした印象が残ってノスタルジックな雰囲気が出るわけです。その逆に、映画をあえて48Pとか60Pといったハイフレームレートで撮るケースもあります。人間にとっては24Pが生理的に合うと言われており、「映画っぽく見えない」と言われることもあるようですが、次作の「アバター」は120コマで撮られるという話もあり、今後、トレンドになるかもしれません。

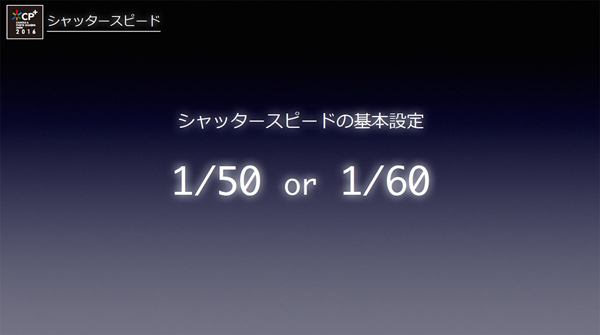

スチールとは異なるシャッタースピードの考え方

2つめのテーマは「シャッタースピード」です。スチールのシャッタースピードは自由度が高いですよね。スローシャッターで撮って迫力ある動きを表現したり、動きの速いものを高速シャッターで切り取るといった使い方があると思いますが、動画の場合は基本のコマ数が1/50もしくは1/60に決まっています。「もしくは」と言ったのは、東日本と西日本では電源周波数が違うからです。それぞれに合わせておかないと、蛍光灯の下で撮影する際にフリッカーが出てチカチカしてしまうからなんです。東日本なら1/50、西日本なら1/60にすればいいということになります。

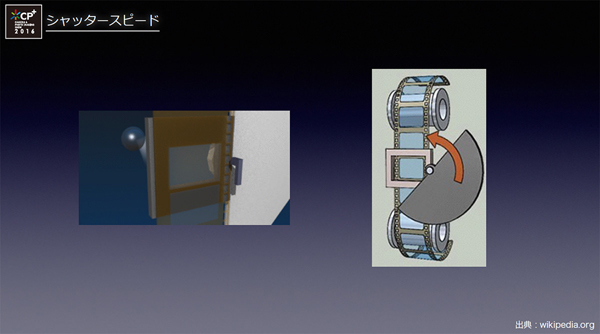

ではなぜ、シャッタースピードを一定にすべきなのでしょうか。それはフィルムのシネカメラの構造を基本としているからなんです。昔のシネカメラは、図のようにフィルムが縦に流れ、その前を回る円盤の角度を変えることでシャッタースピードを変えるという仕組みでした。その際の角度を狭めればシャッタースピードは速く、開くと遅くなります。

シネカメラのシャッタースピードは回転する円盤の角度で決まった。

シネカメラのシャッタースピードは回転する円盤の角度で決まった。

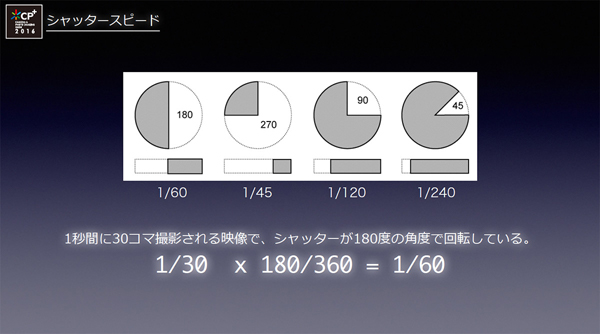

この時、シャッターの角度を180度に設定しておくと、被写体のブレが表現されて映像になった時に非常に自然に見えたわけです。ですから、秒間30コマの場合は1/60秒に、24コマの場合は1/48にするのがいい、ということになったわけです。現在のDSLRの場合は、シャッタースピードをより高速に設定することもできますが、画がパラパラとしてしまい、動画が自然に見えなくなってしまいます。ミュージックビデオなどではあえてパラパラとさせるためにシャッタースピードを上げることもあるんですが、基本は50もしくは60分の1である、と覚えておくといいでしょう。

LogとLUTとは

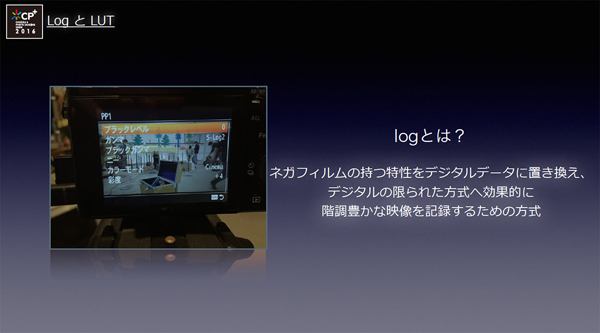

次に「Log」と「LUT」について見ていくことにしましょう。DSLRの中でもLogでの記録に対応している機種と、そうでない機種があります。ソニーで言うとα7 II、α7R II、α7S II、α7Sといった機種が「S-Log」というLog形式での保存に対応しています。Logは限られたデータ量の中でもダイナミックレンジが活かされるように考えられた保存方式のことです。人間の目の特性を研究した上で、一番敏感に見えるところのデータを効率よくデータの中に詰め込みます。なお、Logでの保存はできないニコンのDSLRでは、その代わりに「フラット」と呼ばれるモードを搭載していて、広い階調を撮る工夫がなされています。

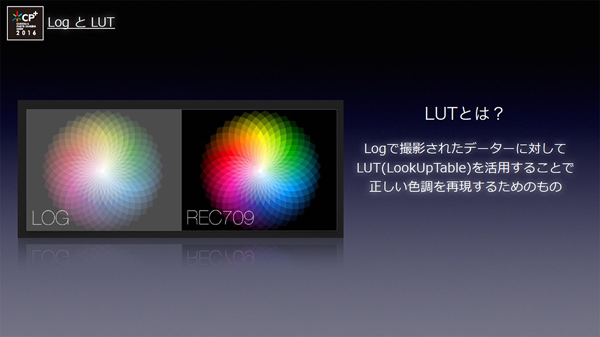

Log形式で撮った動画は、俗に言う“眠い画”になります。色味が浅く、黒が締まっていない印象ですが、広いダイナミックレンジのデータが収められているからそう見えるわけです。そこに「LUT」つまり、ルックアップテーブルを適用することで映像はガラッと変わり、狙った画を表現することができます。この作業を「LUTを当てる」などと言います。LogとLUTは一対である、と考えておくといいでしょう。

Logで撮影した動画はLUTを当てることで狙った画像になる。

Logで撮影した動画はLUTを当てることで狙った画像になる。

フィールドレコーダーを活用する

次に紹介するのは「フィールドレコーダー」です。フィールドレコーダーとは、モニター付きのレコーダーのことで、内蔵したSSDやSDカードに映像を収録する機器のことです。この数年、各社からさまざまな機種が登場しています。なぜフィールドレコーダーを使うのかというと、よりよい映像が収録できるからです。DSLR動画の多くは「4:2:0」と呼ばれるフォーマットで、しかも非常に圧縮率の高いH.264形式で保存されてしまいます。

この中で唯一、キヤノンのEOS-1D X Mark IIが、MotionJPEGで、8ビットの「4:2:2」の低圧縮率で収録できるわけですが、多くのDSLRはハードウェアの限界もあって高い圧縮率で記録せざるをえないわけです。これがフィールドレコーダーを使うことによって、より低い圧縮率で収録ができるようになります。よりよい信号で撮っておけば、当然ですが、その後のカラーグレーディング等の作業でより豊かな表現ができるということになります。

収録時にさまざまなメリットがあるフィールドレコーダー。高品質な映像収録には欠かせない。

収録時にさまざまなメリットがあるフィールドレコーダー。高品質な映像収録には欠かせない。

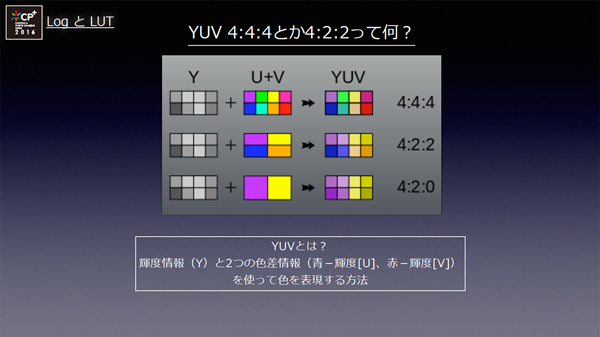

「4:2:2」とか「4:2:0」というのは、動画用語ですのでなじみの薄い方も多いと思います。これは、色を輝度情報(Y)と、「青ー輝度(U)」「赤ー輝度(V)」2つの色差情報を使って表現する方法で、「YUV」形式と呼ばれます。画質の良い方から「4:4:4」「4:2:2」「4:2:0」となります。

図で見ていただけるとわかるとおり、「4:4:4」ではすべてのドットをサンプリングしていますが、「4:2:2」の場合、「U+V」では隣り合ったピクセルの左の色しかサンプリングしていません。こうすることで圧縮をしているわけです。「4:2:0」ではさらにデータが圧縮されていることがわかると思います。

YUV形式それぞれの画像の保存形式の違い。「4:4:4」が最高画質となる。

YUV形式それぞれの画像の保存形式の違い。「4:4:4」が最高画質となる。

カメラの内部収録ではなく、HDMI経由でフィールドレコーダーに録画すると、例えば「4:2:2」での収録が可能になります。ただし、フィールドレコーダーの取り付け方、接続ケーブル、コネクターなどしっかりとしたものを選択しないといけません。引っ張ったら抜けてしまった、では話になりませんから、しっかりとした機材を整えることも大事になります。

なお、フィールドレコーダーには他のメリットもあります。外部モニターが装着されているために、フォーカスの精度も上がりますし、クライアントやディレクターに映像をチェックしてもらう体制をとることもできます。というわけで、最近のムービーの現場では、DSLRを使うならフィールドレコーダーが必須になってきています。

モニターで気を付けたい点

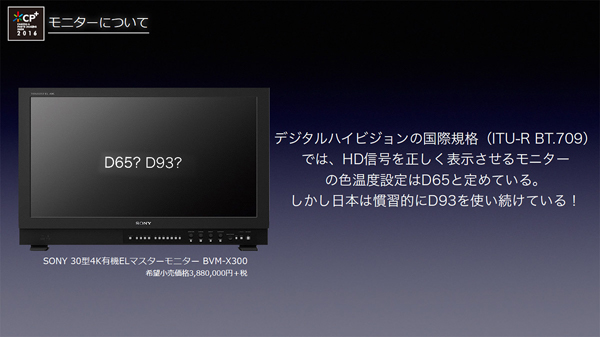

次にモニターです。スチールの現場でもキャリブレーション、モニター品質の重要性が言われているかと思いますが、ムービーの現場でも同様です。ここで触れておきたいのは色温度についてです。出版や写真の世界では「D50」が基準になっているかと思うのですが、映像の世界では2つの基準があって、混乱の元になっています。

デジタルハイビジョンの国際規格である「ITU-R BT709」では、ハイビジョンを正しく表示させるためのモニター環境の設定を「D65」、6500ケルビンに定めています。一方、日本では慣習的に「D93」、9300ケルビンを使い続けています。編集、ポスプロ、グレーディングまで何も言わないとD93で作業が行なわれるのです。D93のモニターで作業し、最終的に地上波でオンエアされるならまったく問題ありません。製作者が白のつもりで撮った色を、最終的に白と感じることができます。

しかし、Web用の映像を作る時には基本的にはD65が基本になります。また、作業を行なう環境もD65環境の可能性がある。例えばD93環境で撮影や編集を行なった映像をD65のモニターで観ると、色が転んで、全体的に赤っぽく見えて「なんだこれは」ということになる。こういった事態を避けるためには、最初から色温度に関するルールを決め、作業するモニターの色温度を変える必要があるのです。

例外はあるかもしれませんが、家庭用テレビで流れるならばD93、海外向け、あるいはネットのストリーミングであればD65で作るということを覚えておきましょう。

カメラワークが表現を深める

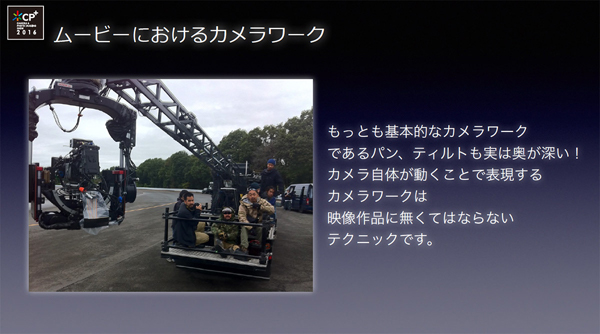

さて、ここからはカメラワークについて話をしてみようと思います。僕も日々勉強している分野ですが、僕が思うに、スチールとムービーのもっとも大きな違いというのは「時間軸」にあると思います。15秒だろうが2時間だろうが、そこには時間の概念が組み込まれ、カメラ自体が動きます。パン、クレーンを使ったアップダウン、カメラを横に動かすドリー、さらにはトラックインやトラックアウト。3次元空間の中をカメラが動いていく表現が多数あるわけです。

フォトグラファーには敷居が高いかもしれませんが、そういう表現にチャレンジすることによって、世界が広がっていくのではないかと思います。例えば、映像を見る際に、カメラがどう動いているかというのを考えながら見ていただくのがいいと思います。最近の動画は本当にカメラ自体がよく動きます。そして、そういった動きが出演者の気持ちや状況をダイナミックに表現していると感じます。

一般的に、ダイナミックな動きを組み入れた撮影は、規模が大きくなり、予算もかかります。ですが、サイズの小さなDSLRを使えば、規模をそれほど大きくせずとも動画に動きを取り入れることができます。

次にお見せするのは、PANTHERというプロ用機材の会社がリリースしているインタビュー映像制作時の映像です。シンプルなスライダーを使ってちょっとした動きを付けていることがわかるでしょうか。これだけでも仕上がりの印象は大きく変わりますよね。ちょっとしたレールを用意するだけでも魅力的な映像が撮れるわけです。こういった機材はレンタルもできますし、スライダードリーであれば安価に購入することもできます。動画で次なるステップを目指すなら、フレームで勝負するだけではなく、カメラ自体を動かして映像の魅力を引き出してほしいと思います。

ドリーを使用し、インタビュー映像に一味加える https://vimeo.com/84376387

「DaVinci Resolve」とはどんなソフトか

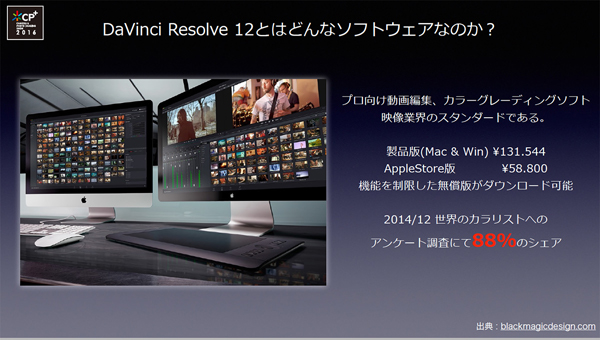

さて、ここから先は「DaVinci Resolve」という映像グレーディングソフトについて解説していこうと思います。DaVinci Resolveはプロ向けの動画編集、カラーグレーディングの業界スタンダードと言えるソフトです。Blackmagic Designからリリースされており、13万1,544円(Mac App Storeでは5万8,800円)するものなのですが、無料版があって、ほぼ機能制限なく利用できる点が人気の秘密でもあります。ノイズリダクションの一部やマルチGPUの計算などが端折られているのですが、通常で使う分にはほぼまったく問題がありません。みなさんには今日にでも試してほしいソフトです。

「DaVinci Resolve」

https://www.blackmagicdesign.com/jp/products/davinciresolve

「DaVinci Resolve」

https://www.blackmagicdesign.com/jp/products/davinciresolve

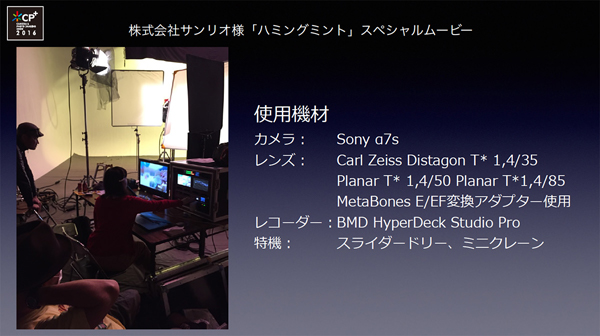

DaVinci Resolveを使った作品を見ていただこうと思います。これはサンリオの「ハミングミント」というキャラクターのスペシャルムービーで、私が撮影したものです。

サンリオ「ハミングミント 〜はっけんのもり〜 冬編」

カメラはソニーのα7S、レンズはDistagon T* 1.4/35、Planar T* 1.4/50、Planar T* 1.4/85の3本を使いました。これらツァイスのレンズは絞りがF1.4で共通なので、レンズを交換しても絞り値が変わらず使いやすいのです。これらのレンズをE/EF変換アダプタを使って装着しています。

フィールドレコーダーにはBlackmagic Designの「HyperDeck Studio Pro」を使いました。カメラから出したHDMIの映像をそのまま読み込んで収録しています。基本はHD、一部4Kで収録しています。使用した機材はスライダードリーとミニクレーン。一人でもオペレートできる程度の小さなものだけです。映像を見ていただければわかるかと思いますが、解像感のある狙っていたとおりの映像が撮れました。

映像の編集も可能

撮影した映像をDaVinci Resolveで編集してみましょう。まずプロジェクトマネージャーを開いて、新しいプロジェクトを作ります。名前を付け、プロジェクトをダブルクリックすると図のような画面になります。まずは映像を「メディア」のページで読み込みます。映像は「4:2:2」、24Pで撮影されています。表示を切り替えてサムネール表示、もしくはリスト表示にすると解像度やfps、オーディオチャンネル、ファイルの継続時間などが表示されますので読み込みを行ないましょう。

「メディア」のページで撮影した映像から使用するものを読み込む。読み込んだ映像はメディアプールに入る。

「メディア」のページで撮影した映像から使用するものを読み込む。読み込んだ映像はメディアプールに入る。

メディアのページで素材を読み込んだら、次にエディットのページに進みます。ここで編集をして、カラーのページでグレーディング、最終的にデリバーで任意のファイル形式で出力します。使用した映像をタイムラインにドラッグしてイン点・アウト点を設定してつないでいきます。左から右に向かって時間が過ぎていくという感覚です。このあたりは、Final Cut Pro XやAdobe Premiere Proと同じです。これで2カットの編集ができました。基本的にはこの繰り返しで編集していくわけです。

イン点・アウト点を設定し、2つの映像をつなぐ。DaVinci Resolveは最新バージョンで編集機能も向上した。

イン点・アウト点を設定し、2つの映像をつなぐ。DaVinci Resolveは最新バージョンで編集機能も向上した。

カラーグレーディングの基本とは

さてDaVinci Resolveというと、何といってもグレーディング機能が充実しています。ここからはメインのグレーディングの話をしてみたいと思います。「カラー」がグレーディングを行なう画面です。タイムラインに、先ほど並べたものの1カット目、2カット目が見えています。

グレーディングは「プライマリ」で画面全体の調整を行ない、「セカンダリ」で部分的な調整をしていく、というのが基本的な考え方となります。まずはプライマリで色味を変えてみたいと思います。「カラーホイール」を使って色味を変えていきます。4つあるホイールは左から、「リフト」「ガンマ」「ゲイン」「オフセット」となります。それぞれの役割はPhotoshopを使っている方ならおおよそわかるのではないかと思います。

カラーホイールには「リフト」「ガンマ」「ゲイン」「オフセット」の4つがある。それぞれを使って全体の色味を調整する。

カラーホイールには「リフト」「ガンマ」「ゲイン」「オフセット」の4つがある。それぞれを使って全体の色味を調整する。

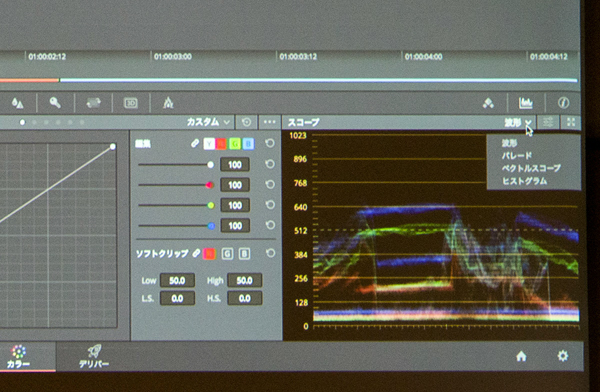

グレーディングの作業をする場合には、映像のモニターよりもむしろ、「ヒストグラム」「波形」「ベクトルスコープ」を見る必要があります。人の目ではなかなか正確な判断ができません。色の傾向を確認する場合には「波形」、明るさに関しては「スコープ」という波形モニターを使うと見やすいと思います。まずはオフセットを調整して、全体をちょっと青くしてみます。この波形モニターでいうと、「ゲイン」は波形の上の方の部分の明るさを動かし、「リフト」は下の部分の明るさを動かす時に使うと考えるといいでしょう。なお、「ゲイン」や「ガンマ」は中間値を調整する際に使います。

「スコープ」は表示を切り替えながら画面の色や明るさを確認する。「波形」表示では全体の色味を、「ベクトルスコープ」表示では明るさを確認しやすい。

「スコープ」は表示を切り替えながら画面の色や明るさを確認する。「波形」表示では全体の色味を、「ベクトルスコープ」表示では明るさを確認しやすい。

別の素材でもやってみたいと思います。今度は女性のカットです。メディアに映像を読み込んで、エディットページでタイムラインを作ります。そうしてからカラーページで調整をします。ちなみにこの素材は、Blacmagic Designの「URSA Mini」という最近登場したカメラを使って、RAWで撮影したものです。RAWの場合は、このカラーホイールの一番左の部分にあるカメラのマークをクリックすると、RAWの調整ができます。ここでカラースペースを「BDF」、つまりBlackmagic Design Filmにしてみました。これはブラックマジックの言うところのフィルムモード、Logだと思ってもらえば結構です。

作業としては、まずプライマリの作業で、肌色などを見つつ、全体のグレーディングを進め、その後セカンダリで部分的な調整をするというのが全体の流れです。まず全体の明るさを決め、スコープで波形モニターを表示させて調整をします。

まずはプライマリの調整をして全体の明るさを調整する。

まずはプライマリの調整をして全体の明るさを調整する。

まず「ゲイン」を上げて全体的のトーンを上げ、そのうえでリフトで暗部を締める。全体的に明るい素材なので、あまり締めずにふわっとした感じを残すことにしました。さらに彩度をやや上げます。白が飛ばないところから、黒が潰れないところまでを活かす。プライマリではその点を意識して調整をするのがいいと思います。これで全体の感じが決まりました。

さて、セカンダリの作業ですが、ここではあまり時間がないのですが、2枚めの作業のページを追加して調整をします。まず緑の発色が悪いので調整したいと思います。スポイトモードで葉っぱの色を拾い、その彩度を上げます。オフセットとゲインを調整するといいでしょう。これで緑の色が鮮やかになったのがわかるかと思います。

セカンダリの画面では部分的な調整をする。スポイトを使って調整したい部分を選択してから調整をすることも可能だ。

セカンダリの画面では部分的な調整をする。スポイトを使って調整したい部分を選択してから調整をすることも可能だ。

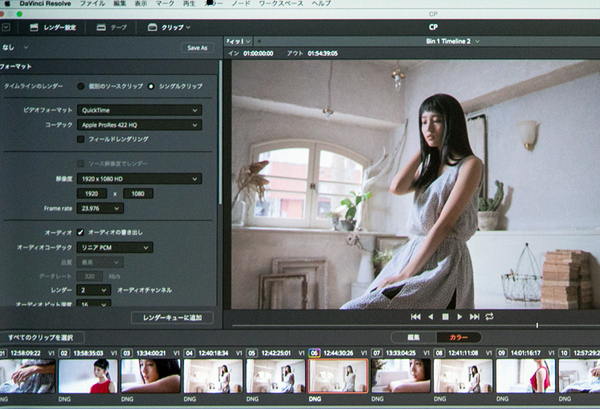

編集が終わったら出力の指定を

色の調整が終わったら、最後に「デリバー」の作業をします。作業した映像を書き出す作業です。まずビデオフォーマットですが、これにはAVCとかDVXとか、いろいろチョイスがあります。CMだと連番のTIFF、あるいはDTXで書き出すこともあります。解像度や音などの設定をして書き出しをします。

「デリバー」の画面では、書き出しに関する細かな設定を行なう。

「デリバー」の画面では、書き出しに関する細かな設定を行なう。

と、ここまでさわりのところしかご紹介できませんでしたが、たとえば肌色に赤みを足したり、背景の壁だけトーンを落としたりといったPhotoshop的な映像作りも可能です。しかも無料です。動画で何か作品を制作するなら、ぜひ使ってみてください。映像を勉強するには、映画やコマーシャルが参考になると思います。編集や色を意識してご覧になったら、またスキル向上につながると思います。

さて時間となったようです。駆け足でしたが、今回のセミナーはここで終わりです。今日は長い時間、どうもありがとうございました。

取材:小泉森弥